无限长度视频 AI 生成模型

SkyReels-V2 是一个由 AI 驱动的视频生成模型,能够根据文字描述或输入图片生成高质量、连贯的短视频,甚至支持无限延长视频长度。

它由团队 SkyworkAI 开发并开源,适用于影视创作、广告设计、动画制作等场景。

这个开源项目最大的亮点是:解决传统模型 AI 视频长度受限的问题,传统 AI 视频生成模型一般 3~4S 的视频。

下面这几个视频都是使用 SkyReels-V2 扩散强制模型生成的 30 秒视频:

开源地址:https://github.com/SkyworkAI/SkyReels-V2

**①文本生成视频(T2V):**输入一段文字(如“湖面上优雅的天鹅游动”),模型即可生成符合描述的动态视频。

**②图像生成视频(I2V):上传一张图片,模型会根据图片内容生成动态延伸的视频(如静态风景图变为流动的湖面)。**③ 无限长度生成:通过“ Diffusion Forcing ”技术,模型可分段生成视频并自动拼接,实现超长视频的无缝衔接。④ 专业级镜头控制:支持调整镜头角度、运动轨迹(如推拉镜头、平移),模拟电影级拍摄效果。

用聊天记录,微调大模型

利用**个人微信聊天记录来微调大语言模型,从而生成一个类似用户聊天风格的“数字克隆人”。**还能绑定到微信、 QQ 、企微,实现自己的数字分身。

它通过LoRA(一种轻量化的微调方法)和 RAG(通过外部知识补充模型能力)技术,将用户真实的对话数据“教”给 AI,使其能模仿用户的语言习惯和回复逻辑。

开源地址:https://github.com/xming521/WeClone

实现过程分为数据准备、模型训练和推理三部分。用户需要先用 PyWxDump 工具导出微信聊天记录的 CSV 文件,经过手机号、网址等隐私信息过滤后,将数据转换成模型可读的格式。

训练阶段支持单卡或多卡并行,允许调整训练批次、学习率等参数防止过拟合。最终可通过网页端与训练好的 AI 对话,虽然作者提到用 2 万条数据训练后效果时好时坏,但某些情况下能产生有趣的拟真回复。

该项目效果高度依赖聊天记录的数据质量(如对话多样性、信息量)。需要注意微信数据的隐私合规性。

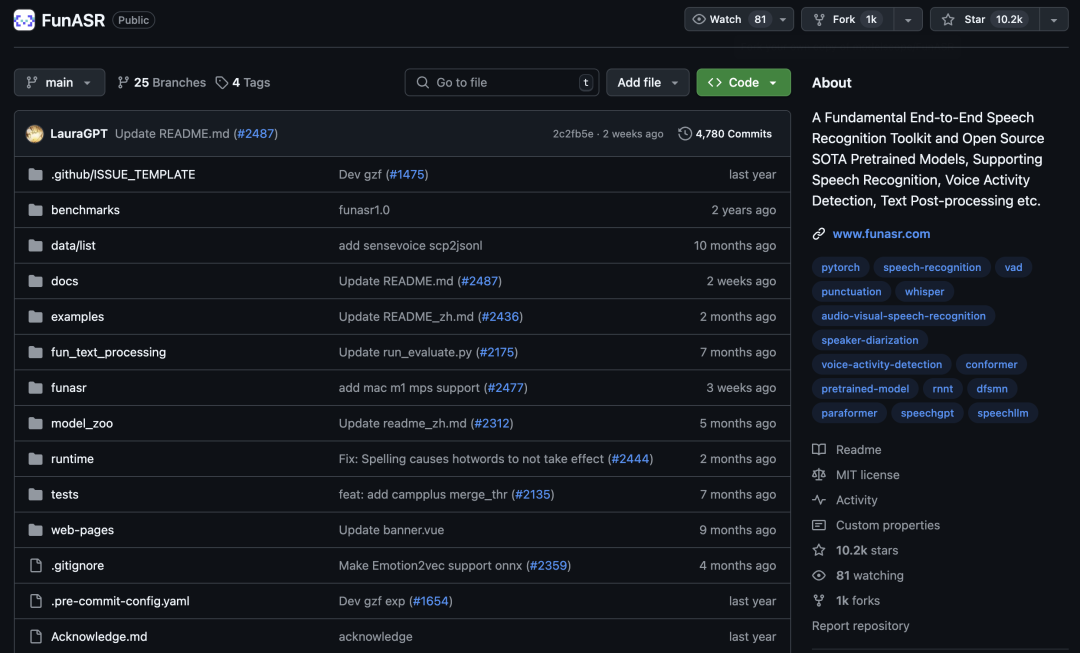

阿里开源的语音转文字神器

FunASR 是由阿里巴巴达摩院 ModelScope 团队开源的端到端 工业级语音转文字 , 支持多人识别,离线语音转写,实时语音转写。

开发者可以用它快速训练、微调语音模型,并直接部署到实际场景(如语音转写服务、实时字幕等)。

开源地址:https://github.com/modelscope/FunASR/tree/main

**① 语音识别(ASR):**支持中英文长音频离线转写、实时流式识别,非自回归模型Paraformer兼顾高精度与高效率(比传统模型快10倍以上)

**② 辅助功能:**语音活动检测(VAD):自动切分有效语音段;标点恢复:为识别结果添加标点;说话人分离:区分多人对话中的不同说话者;情感识别:判断语音情绪(生气、开心、中性、悲伤等)

③多模态扩展:支持Whisper-large-v3、Qwen-Audio等大模型,可处理多语言识别、语音翻译、音频问答等任务